运用了合成数据Qwen3还,学和代码数据比方为扩展数,5的数学和代码模子诈欺Qwen2.,及代码片断等多种景象的数据合成了包罗教科书、问答对以。练方面正在后训,推理才略的根蒂上正在模子具备根本,化练习一连巩固模子才略通义团队诈欺大范畴强,等20多个通用规模使命上操纵了加强练习还正在指令遵守、款式遵守和Agent才略,才略巩固的同时正在保障模子推理,通用才略抬高了。

表此,户还提到多位用,过分斟酌的题目Qwen3存正在,进程太长导致斟酌,杂乱的使命来说异常不行用并且默认的头脑形式对更,要用户举办切换因而斟酌形式需。

DeepSeek正在憋大招的又有。谷歌、Meta等先后推出最新模子跟着阿里、百度、OpenAI、,V3和R1模子遗失绝对当先上风DeepSeek此前一度登顶的,R2模子的推出全寰宇都正在守候。

里来说对阿,竞赛的中枢战术开源是面临墟市,有本能做到当先但这也意味着只,蓄志义开源才。Seek一开源正如Deep,的主动适配和接济就取得良多企业。

爆料称最新,用MoE架构R2仍然采,2万亿参数具有1.,o低廉97.3%本钱GPT-4,力更强视觉能。

队展现该团,维度一连擢升模子异日规划从多个,架构和教练举措包罗优化模子,延伸上下文长度、拓宽模态畛域等主意告终扩展数据范畴、扩展模子巨细、,化练习以举办长周期推理并诈欺境遇反应推动强。

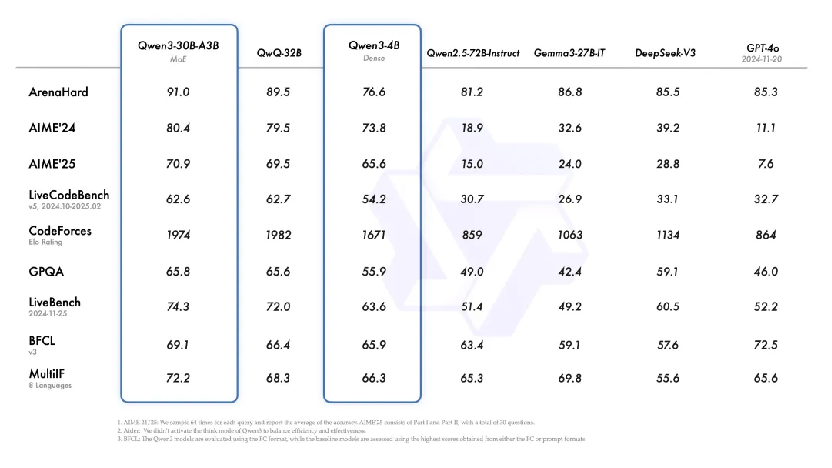

样仅有40亿参数的模子就连Qwen3-4B这,拥有720亿参数模子的本能也能抗拒Qwen2.5中,pSeek-V3和GPT-4o数学、编码等测试也能赶过Dee。

现正在其它模子当中如许的才略同样体。0B-A3B的激活参数目仅有30亿另一款幼型MoE模子Qwen3-3,32B的10%仅有QwQ-,0亿、激活370亿)和GPT-4o的参数范畴更远低于DeepSeek-V3(总参数671,中阐扬更胜一筹正在前述九项测试。

能和超等人为智能道程中的一个首要里程碑“Qwen3代表了咱们正在通往通用人为智。团队展现”通义,和加强练习的范畴通过扩展预教练,目标的智能告终了更高。

的一大亮点还正在于Qwen3模子,慢斟酌两种形式具备速斟酌和。斟酌的杂乱题目对付需求深刻,逐渐推理模子会,后给出最终谜底经由深图远虑。求的简易题目对付速率有要,、近乎即时的反响模子则供应神速,型斟酌水准的局限让用户告终对模。

此因,I企业来说对开源的A,步就显得异常症结本领层面的连续进,和生态修建的根蒂这是饱动操纵发作。Qwen3模子跟着阿里更新,无疑又变得加倍紧急了这一场AI开源的竞赛。

公然测试集举办教练刷榜的质疑但很速LLaMA-4面对诈欺,者还发明有测试,映现的基准测试中正在个人官方没有xg111太平洋不尽人意其阐扬。

技留心到搜狐科,k调换群激发了议论这正在DeepSee,点以为有观,发R2即使要,先发V4也应当,为根蒂而举办教练R1恰是以V3,未对R2相合信息做出回应但DeepSeek方面。

练阶段正在预训,到约36万亿tokenQwen3的数据集达,种说话和方言涵盖119,用的数据集范畴的两倍是Qwen2.5采。环球居于前线这种范畴正在,数据范畴都正在20万亿token之下如GPT-4、LLaMA-4等教练。

有报道称此前3月,速R2的研发和颁发过程DeepSeek正正在加,5月初颁发原规划正在,月中旬推出但期望正在3,epSeek方面含糊当时这种说法遭到De。

然当,面予以含糊Meta方,正在乱七八糟的题目但招供模子本能存。前目,- Behemoth模子仍正在教练中范畴最大、本能最强的LLaMA-4。个大招扳回一局Meta能否憋,再看看还要。

一个月比来,R2何时会颁发表界都正在推测,品迭代周期遵循业内产,为会正在5月不少主张认,2进入颁发倒计时这也许意味着R。

际上实,型正正在找寻的核心宗旨这也是目前国表里大模,4o和o3的OpenAI如比来先后更新GPT-,力方面进一步加强正在多模态和推理能。

提的是值得一,B-A22B相对而言Qwen3-235,模更幼参数规,模的(6710亿)的35%约莫仅有R1和V3参数规,A-4-Maverick(超4000亿)同时低于o1(约3000亿)和LLaM,以幼广博的本能告终了幼而美、。

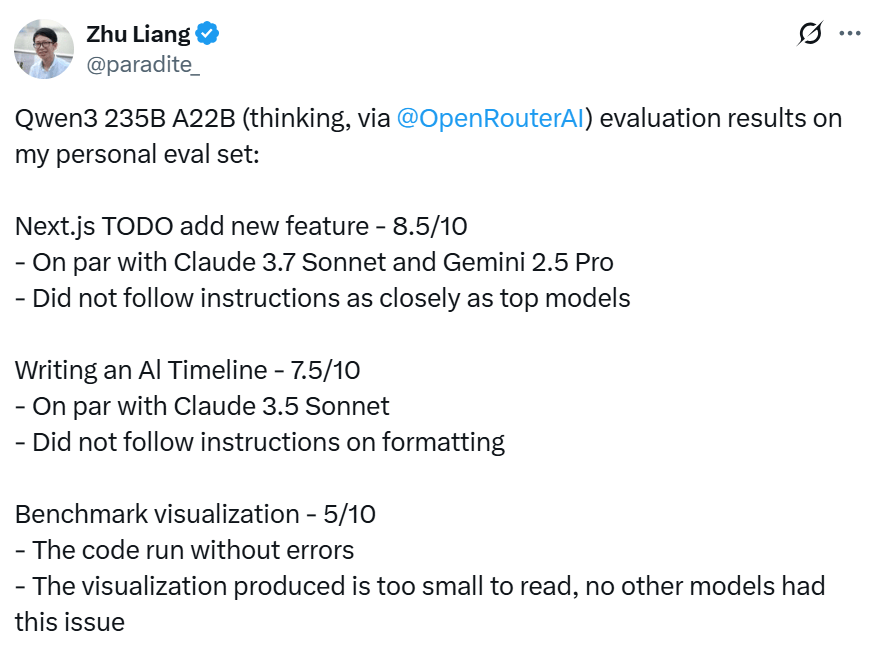

.js举办TODO操纵开采时该用户正在运用开采框架Next,Sonnet和Gemini 2.5 Pro等顶级模子相当Qwen3-235B-A22B 与Claude 3.7 ,没有题目代码运转,格遵守指令但没有苛,因太幼而难以阅读天生的可视化实质权阿里Qwen3登顶全球最强开源。

模子开源这条道上正在阿里所对峙的,型此前超越Llama固然Qwen系列模模型用8款模型夺回中国AI话语,开源模子家族成为环球第一。前一度夺走了留心力DeepSeek此,的大模子本领竞赛更是激发了新一轮。

推荐文章

推荐文章